Tecnologia Científica

Aprimorar a capacidade dos modelos de IA de explicar suas previsões

Uma nova abordagem poderá ajudar os usuários a saber se devem confiar nas previsões de um modelo em aplicações críticas para a segurança, como cuidados de saúde e condução autónoma.

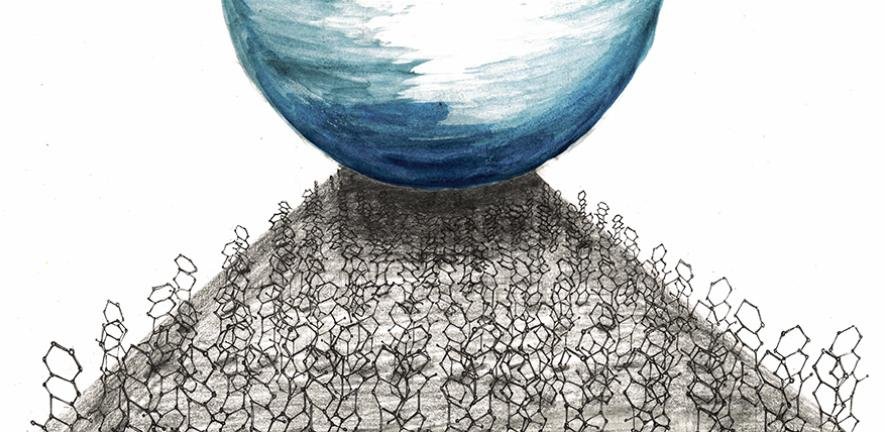

Uma nova técnica transforma qualquer modelo de visão computacional em um modelo capaz de explicar suas previsões usando um conjunto de conceitos que um ser humano possa entender. Créditos: Imagem: MIT News; iStock

Em contextos de alto risco, como diagnósticos médicos, os usuários frequentemente querem saber o que levou um modelo de visão computacional a fazer uma determinada previsão, para que possam determinar se devem confiar em seu resultado.

A modelagem de gargalos conceituais é um método que permite aos sistemas de inteligência artificial explicar seu processo de tomada de decisão. Esses métodos forçam um modelo de aprendizado profundo a usar um conjunto de conceitos, que podem ser compreendidos por humanos, para fazer uma previsão. Em uma nova pesquisa, cientistas da computação do MIT desenvolveram um método que induz o modelo a alcançar maior precisão e explicações mais claras e concisas.

Os conceitos utilizados pelo modelo geralmente são definidos previamente por especialistas humanos. Por exemplo, um médico poderia sugerir o uso de conceitos como "aglomerados de pontos marrons" e "pigmentação variegada" para prever que uma imagem médica mostra melanoma.

No entanto, conceitos previamente definidos podem ser irrelevantes ou carecer de detalhes suficientes para uma tarefa específica, reduzindo a precisão do modelo. O novo método extrai conceitos que o modelo já aprendeu durante seu treinamento para executar essa tarefa em particular e força o modelo a usá-los, produzindo explicações melhores do que os modelos de gargalo conceitual padrão.

A abordagem utiliza um par de modelos especializados de aprendizado de máquina que extraem automaticamente conhecimento de um modelo alvo e o traduzem em conceitos de linguagem simples. Ao final, sua técnica pode converter qualquer modelo de visão computacional pré-treinado em um que consiga usar conceitos para explicar seu raciocínio.

“De certa forma, queremos ser capazes de ler a mente desses modelos de visão computacional. Um modelo de gargalo conceitual é uma maneira de os usuários entenderem o que o modelo está pensando e por que fez determinada previsão. Como nosso método utiliza conceitos melhores, ele pode levar a uma maior precisão e, em última análise, melhorar a confiabilidade dos modelos de IA de caixa preta”, afirma o autor principal, Antonio De Santis, estudante de pós-graduação da Universidade Politécnica de Milão, que realizou esta pesquisa enquanto era aluno visitante no Laboratório de Ciência da Computação e Inteligência Artificial (CSAIL) do MIT.

Ele é acompanhado em um artigo sobre o trabalho por Schrasing Tong SM '20, PhD '26; Marco Brambilla, professor de ciência da computação e engenharia na Universidade Politécnica de Milão; e a autora sênior Lalana Kagal, pesquisadora principal do CSAIL. A pesquisa será apresentada na Conferência Internacional sobre Representações de Aprendizagem.

Construindo um gargalo melhor

Os modelos de gargalo conceitual (CBMs, na sigla em inglês) são uma abordagem popular para melhorar a explicabilidade da IA. Essas técnicas adicionam uma etapa intermediária, forçando um modelo de visão computacional a prever os conceitos presentes em uma imagem e, em seguida, usar esses conceitos para fazer uma previsão final.

Esta etapa intermediária, ou "gargalo", ajuda os usuários a entender o raciocínio do modelo.

Por exemplo, um modelo que identifica espécies de aves poderia selecionar conceitos como "pernas amarelas" e "asas azuis" antes de prever a presença de uma andorinha-das-chaminés.

Mas como esses conceitos são frequentemente gerados antecipadamente por humanos ou grandes modelos de linguagem (LLMs), eles podem não ser adequados para a tarefa específica. Além disso, mesmo com um conjunto de conceitos predefinidos, o modelo às vezes utiliza informações aprendidas indesejáveis, um problema conhecido como vazamento de informação.

“Esses modelos são treinados para maximizar o desempenho, então o modelo pode usar secretamente conceitos dos quais não temos conhecimento”, explica De Santis.

Os pesquisadores do MIT tiveram uma ideia diferente: como o modelo foi treinado com uma vasta quantidade de dados, ele pode ter aprendido os conceitos necessários para gerar previsões precisas para a tarefa específica em questão. Eles buscaram construir um CBM (Modelo Baseado em Conhecimento) extraindo esse conhecimento existente e convertendo-o em um texto que um humano possa entender.

Na primeira etapa do método, um modelo especializado de aprendizado profundo, chamado autoencoder esparso, seleciona as características mais relevantes aprendidas pelo modelo e as reconstrói em um conjunto de conceitos. Em seguida, um modelo de linguagem natural multimodal descreve cada conceito em linguagem simples.

Este modelo multimodal de aprendizado de máquina também anota imagens no conjunto de dados, identificando quais conceitos estão presentes e ausentes em cada imagem. Os pesquisadores usam esse conjunto de dados anotado para treinar um módulo de gargalo conceitual para reconhecer os conceitos.

Eles incorporam esse módulo ao modelo alvo, forçando-o a fazer previsões usando apenas o conjunto de conceitos aprendidos que os pesquisadores extraíram.

Controlando os conceitos

Eles superaram muitos desafios ao desenvolver esse método, desde garantir que o LLM anotasse os conceitos corretamente até determinar se o autoencoder esparso havia identificado conceitos compreensíveis para humanos.

Para evitar que o modelo utilize conceitos desconhecidos ou indesejados, ele é limitado a apenas cinco conceitos por previsão. Isso também força o modelo a escolher os conceitos mais relevantes e torna as explicações mais compreensíveis.

Ao comparar sua abordagem com os modelos baseados em computador (CBMs) mais modernos em tarefas como prever espécies de pássaros e identificar lesões de pele em imagens médicas, seu método alcançou a maior precisão, ao mesmo tempo que forneceu explicações mais exatas.

A abordagem deles também gerou conceitos mais aplicáveis às imagens do conjunto de dados.

“Demonstramos que a extração de conceitos do modelo original pode superar outros modelos baseados em conceitos (CBMs), mas ainda existe uma relação de compromisso entre interpretabilidade e precisão que precisa ser abordada. Modelos de caixa preta que não são interpretáveis ainda superam o nosso”, afirma De Santis.

No futuro, os pesquisadores pretendem estudar possíveis soluções para o problema do vazamento de informações, talvez adicionando módulos de gargalo conceitual adicionais para que conceitos indesejados não vazem. Eles também planejam ampliar seu método usando um LLM multimodal maior para anotar um conjunto de dados de treinamento mais amplo, o que poderia aumentar o desempenho.

“Estou entusiasmado com este trabalho porque ele impulsiona a IA interpretável em uma direção muito promissora e cria uma ponte natural para a IA simbólica e os grafos de conhecimento”, diz Andreas Hotho, professor e chefe da Cátedra de Ciência de Dados da Universidade de Würzburg, que não participou deste trabalho. “Ao derivar gargalos conceituais dos próprios mecanismos internos do modelo, em vez de apenas de conceitos definidos por humanos, ele oferece um caminho para explicações mais fiéis ao modelo e abre muitas oportunidades para trabalhos subsequentes com conhecimento estruturado.”

Esta pesquisa foi financiada pela Bolsa de Doutorado Progetto Rocca, pelo Ministério da Universidade e da Pesquisa da Itália, no âmbito do Plano Nacional de Recuperação e Resiliência, pela Thales Alenia Space e pela União Europeia, no âmbito do projeto NextGenerationEU.